Почему сайт просел в поиске – 9 фатальных ошибок, способных угробить любой сайт

Заголовок статьи говорит о том, что многие владельцы сайтов сталкиваются с проблемой падения позиций в поисковой выдаче. Это может быть вызвано различными фатальными ошибками, которые наносят ущерб продвижению и репутации сайта. Для успешного выхода из ситуации необходимо проанализировать возможные причины падения позиций и разработать стратегию по исправлению ошибок.

Рассмотрим 9 фатальных ошибок, способных угробить любой сайт⁚

- Технические проблемы. Медленная загрузка страниц, ошибки сервера, некорректная настройка https и другие технические недочеты. Это может негативно сказаться на опыте пользователей и ранжировании сайта в поисковой выдаче.

- Дублированный контент. Наличие дубликатов страниц на сайте или зеркал других ресурсов создает путаницу для поисковых систем и может привести к потере позиций.

- Плохая мобильная оптимизация. Неадаптированный под мобильные устройства сайт может упустить значительный трафик и стать менее конкурентоспособным в современных условиях.

- Недостаточное использование ключевых слов. Плохая подборка и оптимизация ключевых слов в контенте и мета-тегах может уменьшить видимость сайта в поисковых системах.

- Нарушения в файле robots.txt. Неправильная настройка файла robots.txt или отсутствие указаний о том, какие страницы должны индексироваться, может привести к нежелательным последствиям.

- Содержание низкого качества. Недостаточно информативные, неоригинальные или низкокачественные тексты могут отразиться на ранжировании сайта и вызвать потерю доверия пользователей.

- Истекшие ссылки. Наличие битых ссылок на сайте или упоминание внешних ресурсов, которые больше не существуют, может негативно повлиять на восприятие сайта поисковыми системами и пользователями.

- Отсутствие безопасности. Недостаточная защита от DDoS-атак, уязвимости или отсутствие SSL-сертификата может создать угрозы для пользователей и уменьшить доверие к сайту.

- Неудачная архитектура сайта. Плохая навигация, неинтуитивная структура или сложное взаимодействие с контентом могут привести к потере пользователей и понижению показателей конверсии.

При возникновении указанных проблем, необходимо провести анализ результатов и определить стратегию по исправлению ошибок. Экспериментировать с контентом, обновлением архитектуры сайта и техническими инструментами может способствовать улучшению показателей и восстановлению позиций в поисковой выдаче.

Важно помнить, что оптимизация, анализ и развитие сайта – непрерывный процесс, требующий внимания к деталям, учитывая конкуренцию, изменения алгоритмов поисковых систем и поведенческие аспекты пользователей.

Поисковая оптимизация много работы для множества различных факторов. Дизайн, техника, содержание. Для продвижения очень важны даже, казалось бы, незначительные детали. Мы уже говорили о наиболее распространенных ошибках веб-дизайна. Сегодня мы собираемся проверить 9 фатальных ошибок SEO, которые могут «испортить» любой сайт.

Фильтры и санкции для поисковых систем .

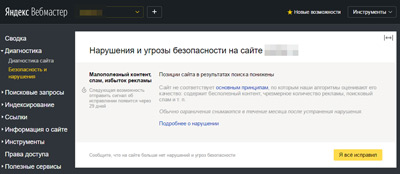

Я рекомендую проверять у веб-мастеров Яндекса и Google наличие штрафных санкций не реже одного раза в неделю. На Яндексе это можно сделать в разделе Диагностика — Безопасность и ошибки . В Google Поисковый трафик — Ручное действие .

По нашему опыту, чаще всего владельцы веб-сайтов не знают об ограничениях. Последний пример из нашей работы:

На сайте много чужих текстов и открытых исходящих ссылок.

Пока все ограничения не будут сняты, продвигать дальше нет смысла. Исправьте все ошибки, сообщите в поисковик и дождитесь снятия санкций.

Революционные санкции — контент.

Мы постоянно говорим о важности текстов. Контент это то, ради чего люди приходят на сайты. Неуместный и неинтересный контент никому не нужен. Поисковые системы занижают такие ресурсы в своем рейтинге, и клиенты устали читать одни и те же тексты шаблонов на сотнях страниц. Доказательство того, что контент может лишить вас хорошей репутации, здесь.

Проверяйте уникальность текстов перед размещением их на text.ru.

Основа SEO-продвижения хорошо подобранные ключевые слова. Это очень важный фактор при определении того, соответствует ли ваша страница вашим условиям поиска.

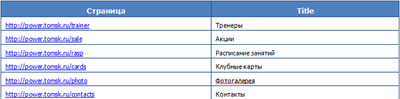

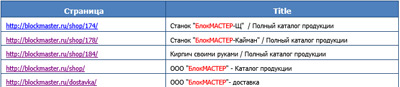

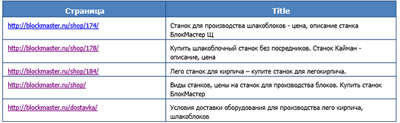

Мы видим две распространенные ошибки. Полное отсутствие ключевых слов в тегах:

.

.

Тег заголовка должен быть завершен как последовательное предложение с включенными ключевыми словами.

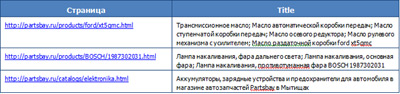

За чрезмерный спам с ключевыми словами в заголовке:

.

.

Важно найти золотую середину. Теги должны быть полезны не только роботам поисковых систем, но и обычным людям. Не забывайте быть информативным.

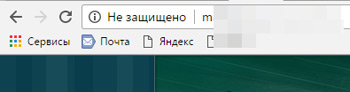

Переход на https

В январе 2017 года Google Chrome (начиная с версии 56) начал отмечать все HTTP-страницы, содержащие любые формы, которые передают личные данные пользователя (адрес электронной почты, пароли, данные кредитной карты и т. д.), как «небезопасные». Кроме того, наличие сертификата SSL немного повышает ваш рейтинг в Google.

Все интернет-магазины должны в первую очередь перейти на протокол https. Важно следовать правильным шагам.

Наиболее частая ошибка просто установите 301 редирект со старой версии http на https после покупки сертификата SSL. Владельцы сайтов забывают про файл robots.txt, директиву Host, конфигурацию веб-мастера. Страница http выпадает из индекса, новая страница https еще не проиндексирована. Все предметы сразу теряются.

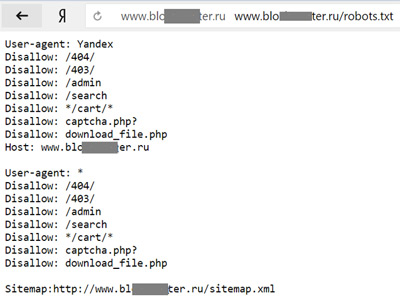

Файл roots.txt

Это текстовый файл, который вы размещаете на своем веб-сайте, чтобы поисковые системы могли его проиндексировать. В этом файле задаются параметры, благодаря которым ваш сайт будет индексироваться поисковыми системами.

Иногда файл robots.txt отсутствует вообще.

Последний пример из работы. Интернет-магазин по продаже станков в рамках услуги продвижения сайта в поисковых системах. Сайт был полностью открыт для индексации поисковыми системами, и на нем вообще не было файла robots.txt.

Компания создала файл robots.txt для индексации поисковыми системами.

Настроил своих роботов, теперь все нормально:

.

.

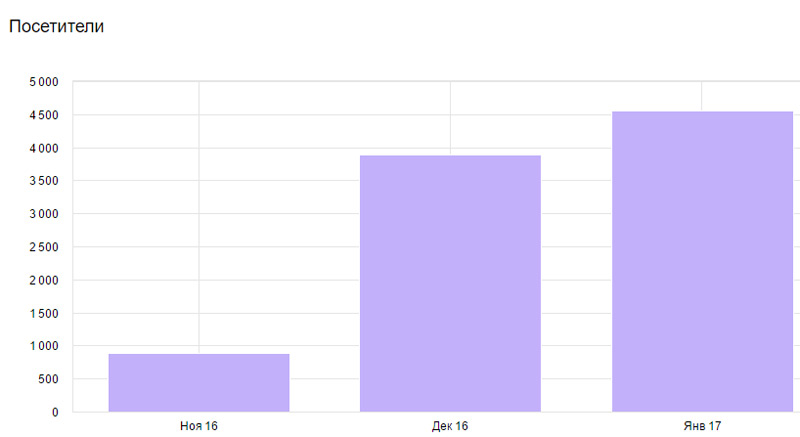

Что именно делали?

Защищенная админ-панель, страницы 404 и 403, страница поиска, корзина перед индексированием. Данный адрес карты сайта и настроенная директива Host.

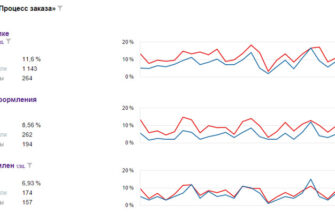

Это, наряду с остальной работой по оптимизации, помогло нам достичь следующих результатов:

Еще одна серьезная ошибка сайт полностью закрыт для индексации. Об этом позаботились директивы Disallow и Allow, которые запрещают или разрешают индексирование разделов, отдельных страниц или файлов соответственно. В поисковых системах есть специальные инструменты для проверки файлов: Яндекс и Гугл.

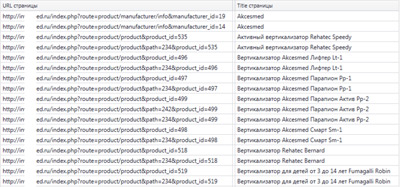

Убедитесь, что на вашем сайте есть файл robots.txt и что он правильно заполнен. Вам следует запретить индексирование всех ваших служебных, поисковых и фильтрующих страниц. Дубликаты страниц, регистрация, авторизация. Страницы корзины и оформления заказа для интернет-магазинов. Узнайте больше о robots.txt. Повторяющееся содержание Повторяющееся содержание или просто повторяющиеся страницы это страницы вашего сайта, которые либо полностью (чистые дубликаты), либо частично (нечеткие дубликаты) идентичны друг другу, но имеют другой URL.

Одна страница может иметь один или несколько дубликатов:

.

.

Поисковые системы отрицательно относятся к дублированному контенту и могут снизить ваш рейтинг из-за отсутствия уникальности и, следовательно, бесполезности для клиентов. Нет смысла читать одно и то же на разных страницах вашего сайта.

Соответствующие страницы могут измениться. Сканер может выбрать отображение дублирующейся страницы, если посчитает, что контент на этой странице более релевантен запросу. Это место потеряет свое положение и значение. В 90% случаев дубликаты вызывают проблемы с ранжированием, и после их удаления сайт сможет улучшиться.

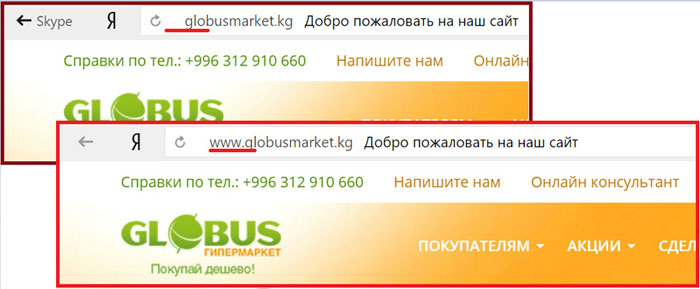

Зеркала сайта

Зеркала — это страницы, которые являются полными копиями друг друга, но доступны из разных мест. Важно связать все зеркальные страницы вместе с помощью переадресации 301.

Индекс заголовка, веса внешних ссылок не должны разделяться, и они будут, потому что поисковые системы рассматривают разные страницы с разными адресами как разные ресурсы. Возможное олицетворение соответствующей страницы в выдаче поисковой системы, дублирование контента. 100% препятствует росту веб-сайта в рейтинге поисковых систем.

Веб-сайт не должен быть открыт для поисковых систем.

Сайт не должен открываться по разным адресам, с www и без, только site.ru и site.ru/index.php, http и https и т. д.:

Контрольный список для проверки:

Страница должна быть доступна только по одному http или https. Выбрано главное зеркало страницы, с www или без него, указанное в Вебмастере. Установлено 301 редирект со всех зеркал.Домашняя страница доступна по одному адресу, без /index.php, /index.html и т. Д. Адаптивная верстка (мобильная версия сайта) .

100% must-have для всех веб-сайтов в 2017 году. В настоящее время рост трафика в мобильных сетях превышает рост трафика в компьютерных сетях. Количество пользователей, использующих смартфоны для совершения покупок, растет с каждым днем во всем мире. Алгоритмы поисковых систем учитывают адаптивные возможности при ранжировании сайта в мобильной версии.

Оптимизированный для мобильных устройств алгоритм Google используется с 2015 года.

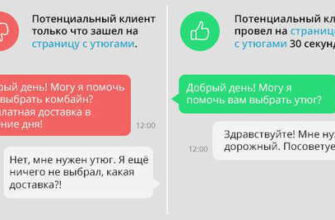

Если ваш веб-сайт по-прежнему не оптимизирован для мобильных устройств вы теряете до половины клиентов каждый день. Узнайте больше о том, почему нам нужно оптимизировать наш веб-сайт. Скорость загрузки страницы .

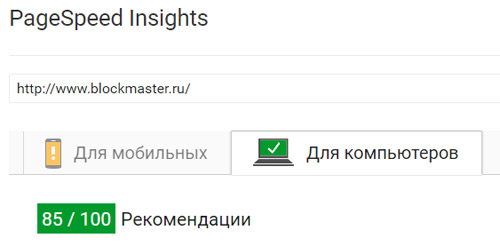

Это просто. Людям не нравятся медленные страницы. Поисковые системы также любят быстрые, оптимизированные страницы. Вы можете проверить, насколько быстро загружается ваш сайт, с помощью инструмента Google. красный медленно, важно срочно увеличить скорость, желтый хорошо, но его можно оптимизировать, зеленый отлично.

Рассмотрим конкретный пример.

Неприемлемый контент

Был написан хорошо продаваемый уникальный текст для домашней страницы.

Перед началом работы:

.

.

После оптимизации:

Ошибки оптимизации

Исправлены теги заголовка и описания, заголовки H1.

Перед началом работы:

.  .

.

После оптимизации:

Файл robots.txt отсутствует.

Был создан и настроен файл robots.txt. Теперь страница правильно индексируется поисковыми системами. Ранее, как указано выше, этого файла вообще не было на странице.

Наличие зеркал, которые не клеются

Зеркала страниц застряли. Веб-сайт был доступен с www и без него. Неверный ответ сервера для несуществующих страниц

Создали отдельную страницу 404 и настроили правильный ответ сервера для несуществующих страниц.

До выполнения работ несуществующие страницы 302 редирект перенаправляли пользователя на главную страницу сайта.